人工智能网络安全威胁图谱 通用应用系统面临的新挑战与应对策略

随着人工智能技术的飞速发展,通用人工智能应用系统正日益渗透到各行各业,从智能客服到自动驾驶,从医疗诊断到金融风控,其广泛的应用前景令人瞩目。伴随而来的是一系列新型网络安全威胁,这些威胁不仅技术复杂、隐蔽性强,且可能造成前所未有的破坏。为此,构建一个清晰的“人工智能网络安全威胁图谱”对于识别、评估和应对这些风险至关重要。

人工智能通用应用系统面临的主要威胁可分为几个核心层面。在数据层面,训练数据的污染、投毒攻击可能导致模型产生偏见或错误决策;对抗性样本攻击则通过细微扰动输入数据,诱使AI系统做出误判。在模型层面,模型窃取攻击可能通过黑盒查询复制商业AI模型,侵犯知识产权;模型逆向工程则可能揭示敏感训练数据,引发隐私泄露。在系统层面,AI系统集成的传统软件漏洞、供应链攻击以及分布式拒绝服务攻击(DDoS)瞄准AI服务接口,威胁系统可用性。AI自身可能被恶意利用,例如生成深度伪造内容、自动化网络钓鱼或自主发起网络攻击,形成“AI攻击AI”的恶性循环。

这些威胁具有动态演化的特性。随着AI技术(如大语言模型、强化学习)的进步,攻击手段也在不断升级。例如,生成式AI可能被用于创造更逼真的社交工程攻击素材,而强化学习智能体可能被训练为自适应网络渗透工具。AI系统的互联互通性增加了攻击面,一个组件的漏洞可能波及整个生态系统,尤其是在云计算和物联网环境中。

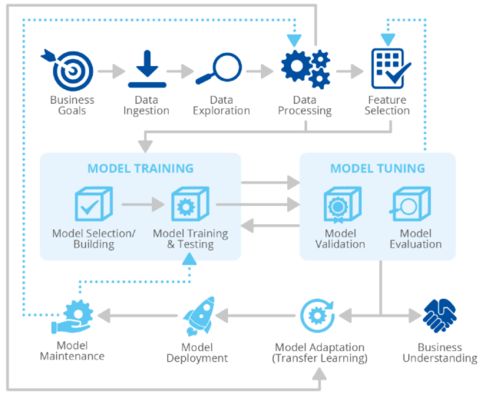

为应对这些挑战,构建全面的威胁图谱需整合多方力量。技术层面,应研发鲁棒的AI算法,如对抗性训练、差分隐私保护和模型水印技术;实施持续的安全监测与威胁情报共享,利用AI自身检测异常行为。管理层面,需建立AI安全标准和法规框架,推动“安全左移”在AI开发生命周期中嵌入安全设计;加强人员培训,提升对AI特定风险的认识。国际合作也至关重要,因为网络威胁无国界,需协同制定全球性治理准则。

人工智能网络安全威胁图谱将持续更新,反映新兴技术如量子计算、边缘AI带来的风险与机遇。只有通过前瞻性研究和协同防御,我们才能确保人工智能通用应用系统在赋能社会的筑起坚固的安全防线,实现可信、可靠、可控的智能未来。

如若转载,请注明出处:http://www.plkwdz.com/product/65.html

更新时间:2026-05-30 00:50:08