欧盟《人工智能法案》解读(一) 通用人工智能分类、提供者义务及行为守则要求

欧盟《人工智能法案》(AI Act)作为全球首个全面监管人工智能的综合性法律框架,标志着人工智能治理正式迈入“硬法”时代。本系列文章将聚焦法案核心内容,本期重点剖析其对通用人工智能(General-Purpose AI, GPAI)的分类监管思路、提供者核心义务及行为守则要求。

一、通用人工智能(GPAI)的界定与分类

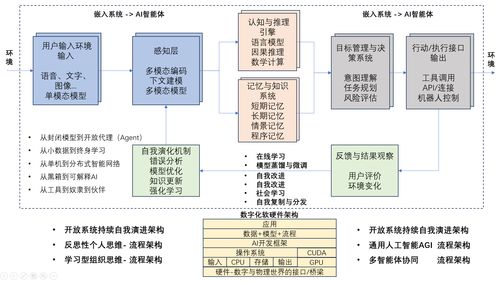

法案创造性地提出了“通用人工智能系统”(GPAI)这一概念,特指那些功能广泛、可服务于多种目的的人工智能系统,例如大型语言模型、多模态基础模型等。这类系统因其强大的泛化能力和广泛的应用潜力,成为监管的重点对象。

法案对GPAI采取了基于风险的层级监管模式:

- 基础层GPAI:所有GPAI提供者均需履行基础义务。

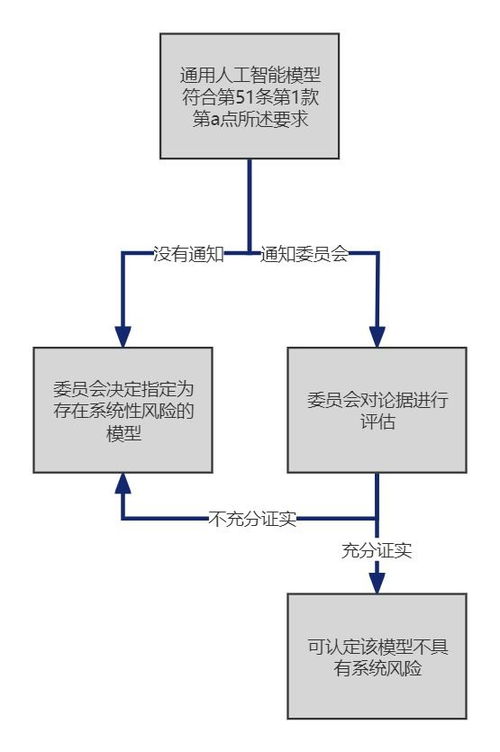

- 具有系统性风险的GPAI:这是法案创设的关键分类。当GPAI模型在训练时所消耗的算力总量超过一个特定阈值(以FLOPs衡量)时,即被认定为“具有系统性风险”。这类模型因其巨大的规模、广泛的影响力和潜在的扩散风险,需要承担更为严苛的合规义务。欧盟人工智能办公室将负责此类模型的清单制定与动态评估。

二、GPAI提供者的核心法定义务

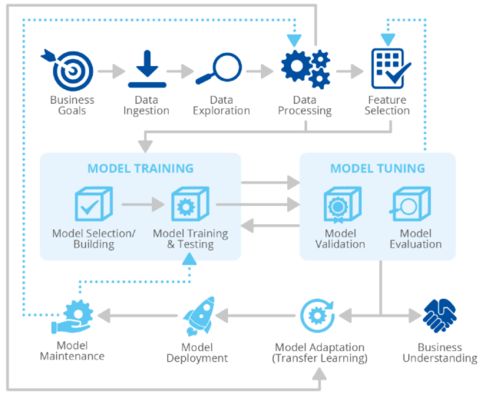

法案为GPAI提供者(尤其是模型开发者)设定了一系列贯穿模型生命周期的义务,旨在确保技术的透明、稳健与可信。

- 透明度义务:提供者必须为下游开发者或部署者提供详尽的技术文档和使用说明。这包括模型的能力、局限性、训练数据的基本特征(如数据范围、规模、处理方式)、计算资源消耗以及已知的风险信息。此举旨在打破“黑箱”,赋能下游用户进行安全、合规的集成与应用。

- 版权合规义务:提供者必须尊重欧盟版权法。法案要求GPAI提供者(特别是生成式AI提供者)公开其训练数据中所使用的受版权保护材料的详细摘要。这一条款旨在平衡技术创新与知识产权保护,为权利人主张其权利提供必要信息基础。

- 对具有系统性风险的GPAI的额外义务:

- 模型评估与风险减缓:必须进行严格的对抗性测试(“红队测试”),以识别、评估和减缓可能出现的系统性风险,如恶意生成内容、自我复制、重大网络安全漏洞等。

- 事件报告:一旦发生任何严重事件或发现任何可能引发系统性风险的故障,必须立即向欧盟委员会和成员国监管机构报告。

- 确保网络安全:必须实施最先进的网络安全措施,保护模型及其权重免受篡改或非法访问。

- 能效报告:需监测和报告模型在训练和运行阶段的能源消耗与资源效率,推动绿色AI发展。

三、行为守则与行业自律倡议

除了具有法律强制力的义务条款,法案还大力倡导和鼓励行业制定并遵守自愿性行为守则(Codes of Conduct)。这被视为对强制性监管的重要补充,尤其在法律细则出台前的过渡期,以及针对尚未被明确认定为“系统性风险”但影响广泛的GPAI模型。

- 守则目标:行为守则应致力于实现《人工智能法案》的总体目标,特别是推动GPAI模型在安全性、可靠性、基础权利保护、社会公益和可持续发展等方面达到更高标准。

- 参与主体:鼓励GPAI提供者、行业联盟、民间社会组织、学术界等多元利益相关方共同参与制定。欧盟委员会将为守则的制定提供支持与协调。

- 核心内容:预期的行为守则可能涵盖:

- 超越法律底线的安全与伦理标准。

- 针对特定高风险应用场景(如医疗、教育)的细化部署指南。

- 促进AI可解释性、公平性和可审核性的行业最佳实践。

- 推动中小企业获取和利用GPAI技术的合作框架。

###

欧盟《人工智能法案》对通用人工智能的监管,构建了“强制合规义务”与“自愿行为守则”双轮驱动的治理体系。它既通过清晰的法定义务(特别是针对具有系统性风险的模型)确立了不可逾越的红线,又通过倡导行业自律为技术创新和卓越实践保留了灵活空间。这种分层、精准的监管思路,旨在驾驭AI的巨大潜力,同时防范其系统性风险,为全球AI法治化进程提供了重要的前沿参考。下一期,我们将深入解读法案对“高风险人工智能系统”的详细监管要求。

如若转载,请注明出处:http://www.plkwdz.com/product/64.html

更新时间:2026-05-30 17:04:51